今日概览

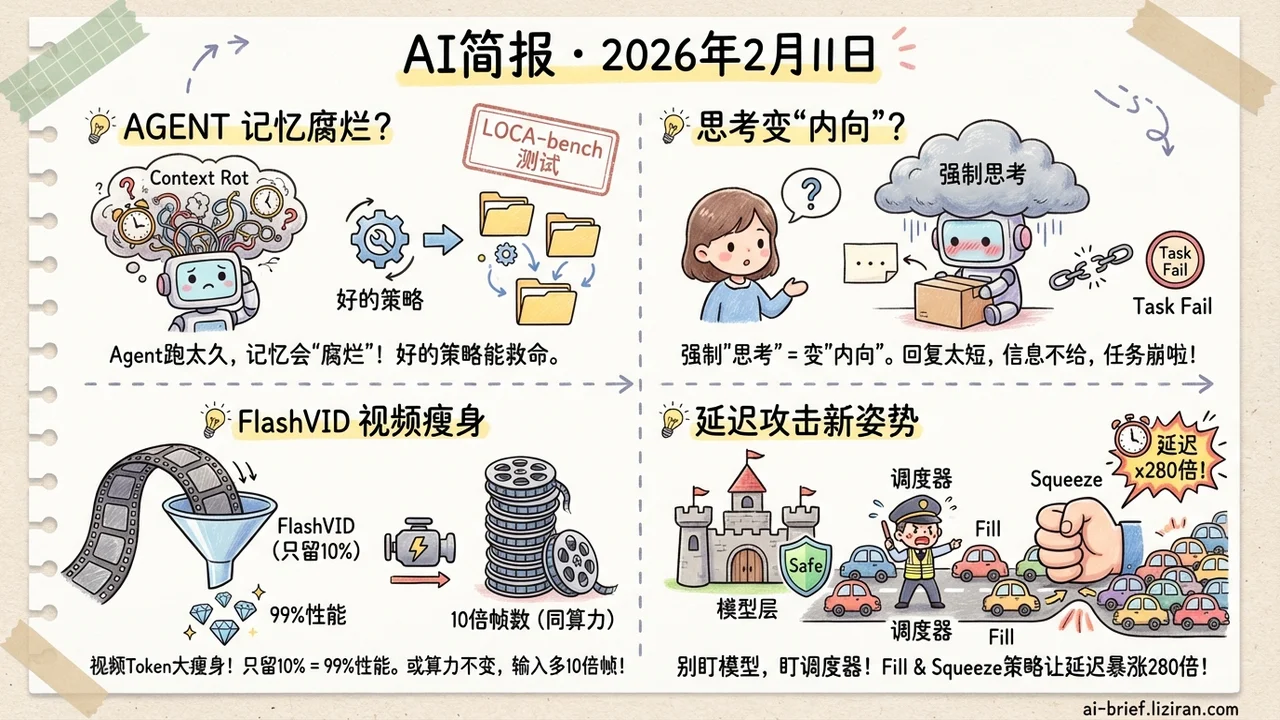

- Agent跑久了上下文会「腐烂」,但好的上下文管理策略能大幅挽回性能。LOCA-bench首次系统测试了长上下文Agent在动态增长环境下的退化问题

- 强制让LLM「思考」再行动反而更差?思考让Agent变「内向」了——回复变短、信息不愿意给用户,导致下游任务连环崩

- 视频理解模型吃token太猛,FlashVID只保留10%的视觉token就保住99%的性能,还能在同样算力下把输入帧数提升10倍

- 攻击LLM推理延迟的正确姿势:别盯着模型层,盯着serving系统的调度器。Fill and Squeeze策略让首token延迟最高暴涨280倍

重点关注

01 评测 Agent跑久了就犯糊涂,到底是模型不行还是上下文的锅?

做过Agent的人都知道,任务一复杂、步骤一多,模型表现就开始飘。但之前的长上下文benchmark基本只测「从长文中找信息」这种单步场景,跟Agent的真实工作方式差得远。LOCA-bench填上了这个空白:它能自动、可控地让环境状态不断膨胀,迫使Agent在动态增长的上下文中持续执行任务——而且任务语义不变,只有上下文在涨。测下来,Agent性能确实随上下文增长明显退化(这不意外),但有意思的是,先进的上下文管理策略能实质性地拉回成功率。换句话说,「context rot」不是模型能力的天花板,而是工程可以解决的问题。做Agent系统的团队,这个benchmark值得跑一遍,看看你的上下文策略到底在什么量级开始崩。

原文:LOCA-bench: Benchmarking Language Agents Under Controllable and Extreme Context Growth

02 Agent 让模型「想清楚再说」,为什么反而把事情搞砸了?

推理(thinking)被当作LLM能力升级的银弹——先想再答,效果更好。但这篇论文做了7个模型、3个benchmark的系统实验,发现了一个反直觉的结论:在需要和用户互动的Agent场景里,强制开启思考模式反而导致性能下降。原因很有意思:思考让模型变「内向」了——回复变短,主动披露的信息变少,Agent和用户之间的信息交换被削弱,下游任务因此失败。更实用的发现是,只要在prompt里显式要求模型主动披露信息,就能跨模型稳定提升表现。做对话Agent的团队注意了:推理能力和信息透明度可能是两个需要分别优化的轴。

原文:Thinking Makes LLM Agents Introverted: How Mandatory Thinking Can Backfire in User-Engaged Agents

03 推理加速 视频理解模型吞token太凶,能砍掉90%还不掉点吗?

视频大模型理解能力越来越强,但视频帧一多,视觉token数量爆炸式增长,推理成本是个大问题。现有的加速方法通常分别压缩空间和时间维度的冗余,忽略了两者之间的关联——同一个物体在不同帧里位置、尺度都在变,固定的空间压缩抓不住这种动态变化。FlashVID(ICLR 2026 Oral)的做法是先用注意力和多样性指标选出最有代表性的token,再用树状结构在时空维度上联合合并冗余token。实测下来,只留10%的视觉token就保住了LLaVA-OneVision 99.1%的性能。更实用的是,省下来的算力可以直接用来喂更多帧——给Qwen2.5-VL输入帧数提升10倍后,同样算力下性能反而相对提升8.6%。做视频理解应用的团队,这是一个即插即用的免训练方案。

04 安全对齐 攻击LLM推理延迟,为什么盯着模型不如盯着调度器?

LLM推理成本高,延迟攻击是个真实威胁。之前的研究主要在算法层面做文章——构造特殊输入让模型产生最长输出。但这篇论文报告了一个反直觉的发现:现代serving系统(如vLLM)的continuous batching机制天然隔离了这种攻击的影响,算法层面的延迟攻击其实不太管用。于是作者换了个角度,把目标从模型转向serving系统的调度器。Fill and Squeeze策略分两步:先用请求填满全局KV cache触发Head-of-Line阻塞,再迫使系统反复做抢占式调度。效果惊人——首token延迟暴涨20-280倍,每token生成时间增加1.5-4倍,而攻击成本比现有方法低30-40%。跑LLM serving的团队,这篇论文是个很好的防御参考,需要关注KV cache的资源隔离和调度抢占的安全策略。

原文:Rethinking Latency Denial-of-Service: Attacking the LLM Serving Framework, Not the Model

也值得关注

今日观察

今天Agent方向的论文密度很高,但有意思的是指向了一个共同主题:Agent的瓶颈正在从「模型能力」转向「系统设计」。LOCA-bench发现上下文管理策略比模型本身更关键,Thinking Agent发现推理能力反而损害交互质量,ALMA发现记忆系统的架构设计才是持续学习的核心。做Agent的团队,现阶段值得把更多精力放在框架层面的工程优化上,而不只是等更强的模型。