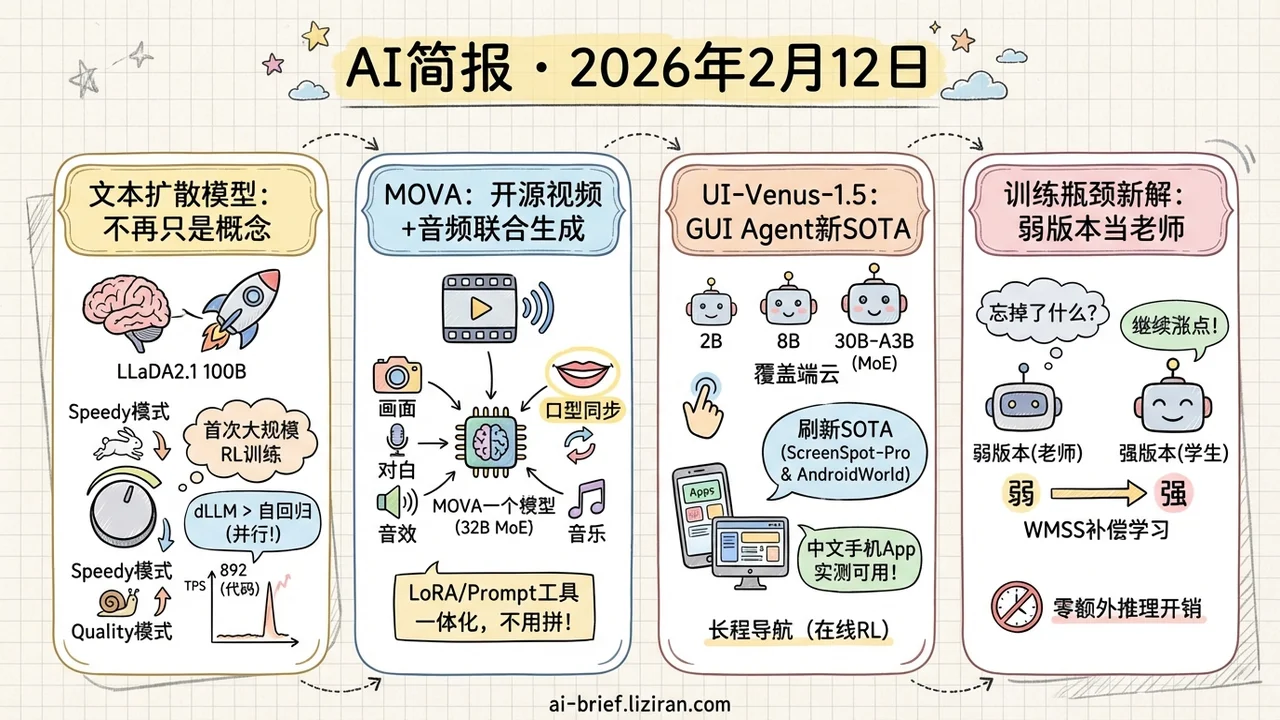

今日概览

- 文本扩散模型不再只是概念验证,LLaDA2.1的100B模型在代码任务上跑出892 TPS,并首次实现大规模RL训练dLLM

- 开源视频+音频联合生成终于有了,MOVA一个模型同时生成画面、对白、音效和音乐

- GUI Agent三个变体覆盖2B到30B。UI-Venus-1.5在ScreenSpot-Pro和AndroidWorld上刷新SOTA,中文手机App实测可用

- 模型训练到瓶颈了怎么办?用自己的「弱版本」当老师反而能继续涨点,零额外推理开销

重点关注

01 模型架构 文本扩散模型终于跑出实用速度了?

自回归生成(一个token接一个token)统治了LLM世界,但它天生是串行的,并行加速有天花板。文本扩散模型(dLLM)理论上可以并行生成多个token,但之前的实际速度和质量都不够看。LLaDA2.1做了两件关键的事:一是把Token-to-Token编辑和传统的Mask-to-Token生成结合起来,通过可调阈值在速度和质量之间灵活切换——「Speedy模式」激进降阈值再用编辑修正,「Quality模式」保守阈值换质量;二是首次为dLLM实现了大规模强化学习,用专门的梯度估计技术让扩散模型也能做RLHF式的对齐。100B模型在代码任务上跑出892 TPS(HumanEval+),远超同体量自回归模型的推理速度。dLLM从「有意思的研究方向」变成了「值得认真评估的工程选项」。

原文:LLaDA2.1: Speeding Up Text Diffusion via Token Editing

02 多模态 视频生成终于不用「先出画面再配音」了

当前视频生成的常规流程是先生成视频,再用另一个模型配音——误差累积、节奏对不上、成本翻倍。Veo 3和Sora 2证明了同步生成的价值,但都是闭源的。MOVA是首个开源的视频+音频联合生成模型,32B参数(18B活跃),用MoE架构同时处理视觉和音频模态。它能生成口型同步的语音、环境匹配的音效和内容对齐的背景音乐,从图片+文字输入直接出带声音的视频。模型权重、代码全部开源,还提供了LoRA微调和prompt增强工具。对想在产品里集成视频生成的团队来说,「画面+声音一体化」不再需要自己拼pipeline了。

原文:MOVA: Towards Scalable and Synchronized Video-Audio Generation

03 Agent GUI Agent想在真实手机上好用,光靠大模型还不够

GUI Agent(自动操作手机/电脑界面的AI)离实用一直差口气:要么能力强但模型太大跑不动,要么轻量但复杂任务搞不定。UI-Venus-1.5提供了2B、8B和30B-A3B(MoE)三个版本,覆盖从端侧到云端的部署场景。三个关键技术升级:100亿token的中训阶段让模型「看懂」GUI语义,在线RL用完整轨迹训练(不是单步打分)让Agent学会长程导航,以及通过模型合并把定位、网页、手机三个专精模型融成一个checkpoint。结果在ScreenSpot-Pro上69.6%、AndroidWorld上77.6%,都是新SOTA。更实际的是,它在多个中文手机App上都实测可用——这在之前的GUI Agent论文里很少见。

原文:UI-Venus-1.5 Technical Report

04 训练优化 模型越训越强,直到有一天不动了——怎么破?

Post-training做到后期会撞上「饱和瓶颈」:模型已经非常自信了,继续训练收益递减。现有方法还在不断强化目标答案,但WMSS换了个思路——用模型自己训练过程中的弱版本checkpoint来指导后续优化。具体做法是通过熵变化找到当前模型的「可恢复学习缺口」(weak checkpoint还行、strong checkpoint反而退步的地方),然后用补偿学习把这些缺口修复回来。在数学推理和代码生成上都有效,而且不增加任何推理成本——改的只是训练流程,部署时完全一样。这个思路对正在做post-training调优的团队很有启发:与其只盯着更好的数据和更强的reward,不如回头看看模型「忘掉了什么」。

原文:Weak-Driven Learning: How Weak Agents make Strong Agents Stronger

也值得关注

今日观察

今天的论文有一个清晰的趋势:RL正在渗透到LLM之外的每一个生成式AI子领域。LLaDA2.1把RL带入文本扩散模型,WorldCompass用RL训练视频世界模型,UI-Venus-1.5用在线RL训练GUI Agent,iGRPO和Dr. SCI在推进推理RL的精细化。做生成式AI产品的团队,不论你的模态是什么,RL post-training正在成为标配能力——值得把GRPO/PPO相关的工程经验列入技术储备清单。