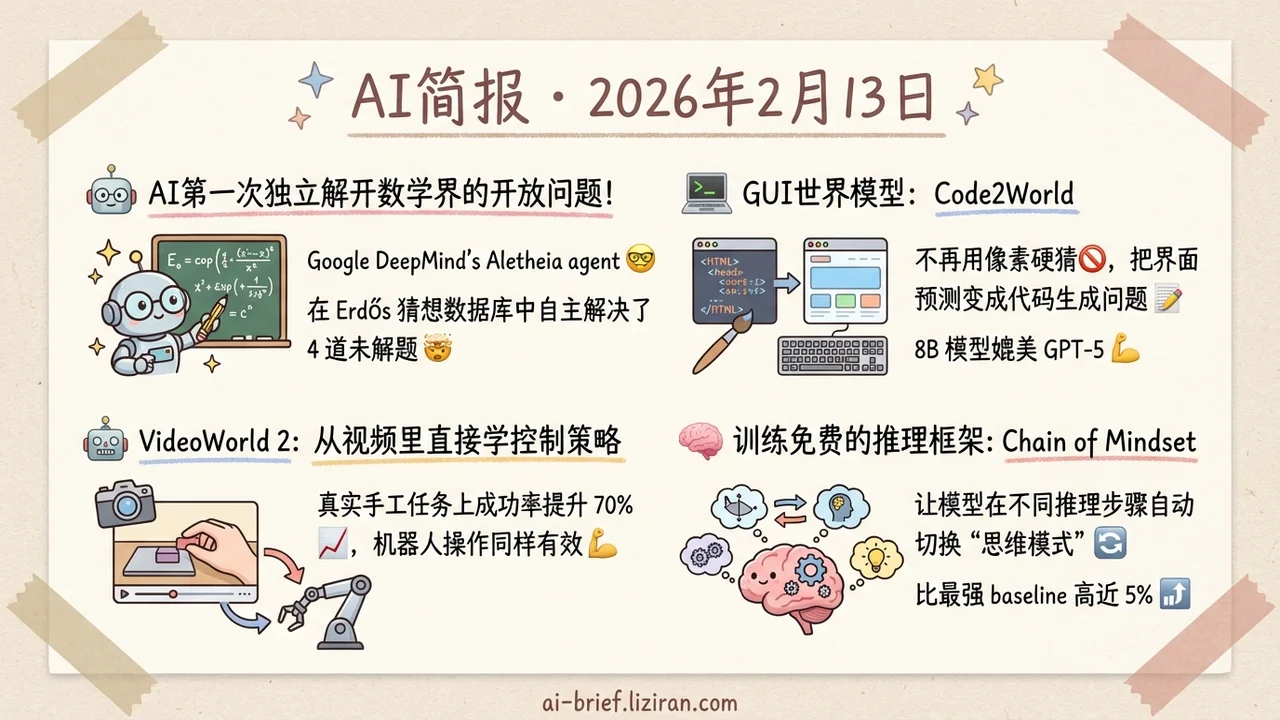

今日概览

- AI第一次独立解开数学界的开放问题,Google DeepMind的Aletheia agent在Erdős猜想数据库中自主解决了4道未解题

- GUI世界模型不再用像素硬猜。Code2World把界面预测变成代码生成问题,8B模型媲美GPT-5

- 从视频里直接学控制策略,VideoWorld 2在真实手工任务上成功率提升70%,机器人操作同样有效

- 训练免费的推理框架,Chain of Mindset让模型在不同推理步骤自动切换「思维模式」,比最强baseline高近5%

重点关注

01 AI for Science AI不只是做数学题了,它开始做数学研究

IMO金牌级的数学能力已经不新鲜,但从「解竞赛题」到「做真正的研究」是另一回事——后者需要检索大量文献、构建长程证明、在未知空间探索。Google DeepMind的Aletheia是一个数学研究agent,基于Gemini Deep Think的增强版本,核心能力是「生成-验证-修正」的端到端循环加上密集的工具调用。最硬的成果是三个:一篇完全由AI独立完成的算术几何研究论文(计算某类结构常数),一篇人机协作证明粒子系统边界的论文,以及对Erdős猜想数据库中700道开放问题的半自主评估——其中4道开放问题被AI自主解决。团队还提出了量化「AI辅助数学成果的自主性和新颖性」的标准框架,这本身就说明他们认为这类成果会越来越多。对行业的信号很明确:AI agent的能力边界正在从「解已知问题」推向「探索未知问题」。

原文:Towards Autonomous Mathematics Research

02 Agent GUI Agent要预判下一步,像素级预测走不通

GUI Agent要做到好用,得能「预判」操作结果——点这个按钮界面会变成什么样。现有的方法要么用文本描述下一步(精度不够),要么用像素生成(结构不可控)。Code2World换了个思路:把「预测下一个界面状态」变成「生成能渲染出那个界面的HTML代码」。团队先用视觉反馈修正机制把8万多组GUI轨迹翻译成高保真HTML训练数据,再用渲染感知的强化学习(把渲染结果当reward信号)来训练模型。结果8B规模的Code2World在界面预测上媲美GPT-5和Gemini-3-Pro-Image,更实用的是它能直接提升下游导航任务:给Gemini-2.5-Flash接上Code2World做预判,AndroidWorld导航成功率提升9.5%。代码已开源。

原文:Code2World: A GUI World Model via Renderable Code Generation

03 机器人 从YouTube视频里学到的操作知识,能迁移到机器人上吗?

让AI通过看视频学会做事,听起来很美但实际很难:视频里的「动作」是隐含的,而且不同场景的视觉差异巨大。VideoWorld 2的核心设计是把「动作动态」和「视觉外观」解耦——用预训练的视频扩散模型负责外观建模,让一个专门的潜在动态模型(dLDM)只学和任务相关的紧凑动作编码。这些编码再用自回归方式建模策略和长程规划。在真实的手工制作任务上(之前的视频生成和潜在动态模型都搞不定的场景),任务成功率提升最高达70%。更重要的是在机器人领域的迁移:从Open-X数据集学到的操作知识,能显著提升CALVIN机器人操作任务的表现。代码和模型都会开源。

原文:VideoWorld 2: Learning Transferable Knowledge from Real-world Videos

04 推理 推理的每一步需要不同的「思维模式」,但现有方法一刀切

人解决复杂问题时会自然切换思维方式——空间想象、发散联想、逻辑收敛、算法执行,不同步骤用不同脑区。但现有的LLM推理方法(包括各种CoT变体)在所有步骤上用的是同一种「心智模式」。Chain of Mindset(CoM)提出了一个无需训练的agentic框架,把推理过程拆成4种异质的认知模式(空间、收敛、发散、算法),由一个Meta-Agent根据推理状态动态选择当前最合适的模式,并用双向上下文门控制模块间的信息流。在数学、代码、科学问答、空间推理6个benchmark上,CoM在Qwen3-VL-32B上整体准确率超最强baseline 4.96%,在Gemini-2.0-Flash上超4.72%,同时保持推理效率。不需要额外训练,直接套用。

原文:Chain of Mindset: Reasoning with Adaptive Cognitive Modes

也值得关注

今日观察

今天最引人注目的趋势是世界模型的集中涌现——Code2World做GUI状态预测,VideoWorld 2做视频动态建模,Olaf-World做跨场景动作迁移,Agent World Model做合成环境生成。方法各异,但指向同一个命题:Agent要在真实世界中好用,必须有一个「内心模拟器」来预判行为后果。做Agent产品的团队,值得认真跟踪世界模型方向的最新进展,它正在从学术概念变成Agent能力的核心基础设施。