今日概览

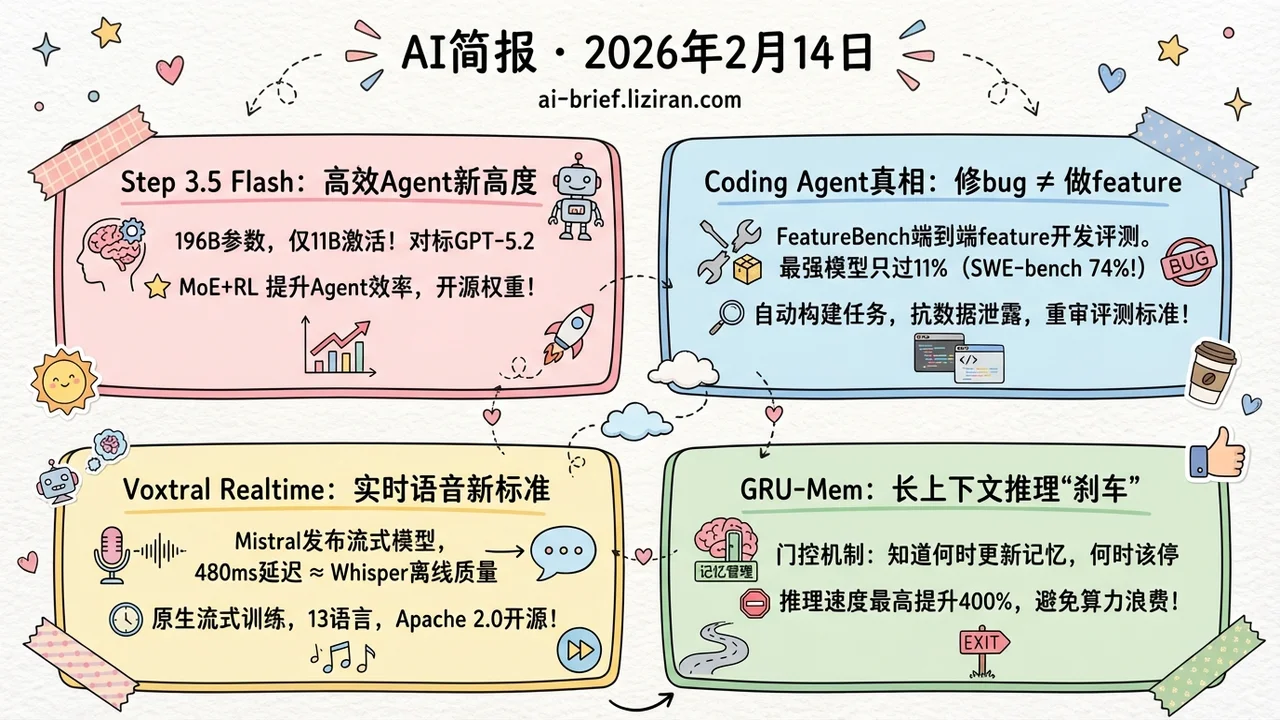

- 196B参数但只激活11B就对标GPT-5.2,Step 3.5 Flash用MoE+RL把Agent效率拉到新高度,开源权重

- Coding Agent能修bug不代表能开发功能。FeatureBench把评测从单PR修复升级到端到端feature开发,最强模型只过11%

- Mistral发布流式语音识别模型Voxtral Realtime,480ms延迟追平Whisper离线转录质量,Apache 2.0开源

- 长上下文推理的记忆管理有了「刹车」,GRU-Mem用门控机制让Agent知道何时更新记忆、何时该停,推理速度最高提升4倍

重点关注

01 Agent 11B活跃参数就能跑frontier级Agent任务,效率边界被重新定义

部署复杂Agent最头疼的不是模型不够聪明,是推理成本太高——多轮交互、工具调用、代码执行,每一步都在烧token。Step 3.5 Flash用196B参数的MoE架构配合仅11B的活跃参数量,把frontier级Agent智能压进了可实际部署的成本区间。技术上有两个关键设计:3:1交替的滑动窗口/全注意力降低多轮交互的延迟,Multi-Token Prediction一次预测3个token加速生成;训练上用可验证信号+偏好反馈的混合RL框架,在大规模off-policy训练下保持稳定自我改进。硬指标:IMO-AnswerBench 85.4%,LiveCodeBench-v6 86.4%,tau2-Bench 88.2%,对标GPT-5.2 xHigh和Gemini 3.0 Pro。对做Agent产品的团队来说,这意味着「frontier级能力」和「可承受的推理成本」终于不再互斥。

原文:Step 3.5 Flash: Open Frontier-Level Intelligence with 11B Active Parameters

02 代码智能 能修bug的Coding Agent就能开发功能吗?差远了

SWE-bench上74%的解题率听起来很厉害,但它测的基本是「给你一个PR里的bug,修好它」——任务边界清晰,改动范围有限。真实的功能开发是另一回事:横跨多个commit、涉及多个文件的依赖关系、还得保证其他功能不被破坏。FeatureBench(ICLR 2026)专门测这个。它从真实代码仓库的单元测试出发,沿着依赖图追踪出跨越多个commit和PR的功能级任务,200道题全部有可执行的测试环境。结果很扎眼:SWE-bench上74.4%的Claude 4.5 Opus,在FeatureBench上只做到11.0%。更实用的是这套任务生成工具是自动化的,可以持续从新仓库中构建新任务,天然抗数据泄露。

原文:FeatureBench: Benchmarking Agentic Coding for Complex Feature Development

03 多模态 流式语音识别不用牺牲质量了

语音转文字一直有个两难:要实时就得分块送入离线模型(质量打折扣),要高质量就得等音频录完再处理。Voxtral Realtime是Mistral做的原生流式ASR模型,不是把离线模型切小块塞进来,而是端到端训练音频流和文本流之间的对齐。架构基于Delayed Streams Modeling框架,新引入因果音频编码器和Ada RMS-Norm来处理延迟条件化,预训练覆盖13种语言。核心结果:480ms延迟下达到Whisper级别的转录质量,Apache 2.0协议开源。对做语音应用的团队来说,这直接解决了「实时性和准确性只能选一个」的老问题。

04 推理 长上下文Agent最该学的一件事:知道什么时候该停

长上下文推理的Agent需要逐段处理信息并维护记忆,但朴素的循环记忆有两个致命问题:看到无关内容也往里塞导致记忆爆炸,以及找到答案后还在继续循环浪费算力。GRU-Mem借鉴GRU(门控循环单元)的思路,给文本记忆加了两道门——「更新门」控制什么时候更新记忆(遇到无证据的文本块就跳过),「退出门」控制什么时候结束循环(证据收集够了立刻停止)。两个门的行为通过端到端RL的专用reward信号来学习。效果是在多个长上下文推理任务上全面超越MemAgent,推理速度最高提升400%。

原文:When to Memorize and When to Stop: Gated Recurrent Memory for Long-Context Reasoning

也值得关注

今日观察

今天有两个信号值得交叉阅读:Step 3.5 Flash在Agent任务上对标frontier模型,FeatureBench和GameDevBench则说「别高兴太早,换个评测维度成绩就大打折扣」。Agent能力和评测标准正在同步升级——模型在做得更好的同时,行业也在发现更多做不好的地方。做Coding Agent产品的团队尤其值得注意:从单PR修复到端到端功能开发、从纯代码到多模态资产,这些更贴近真实工作流的评测方向将重新定义「好用」的标准。