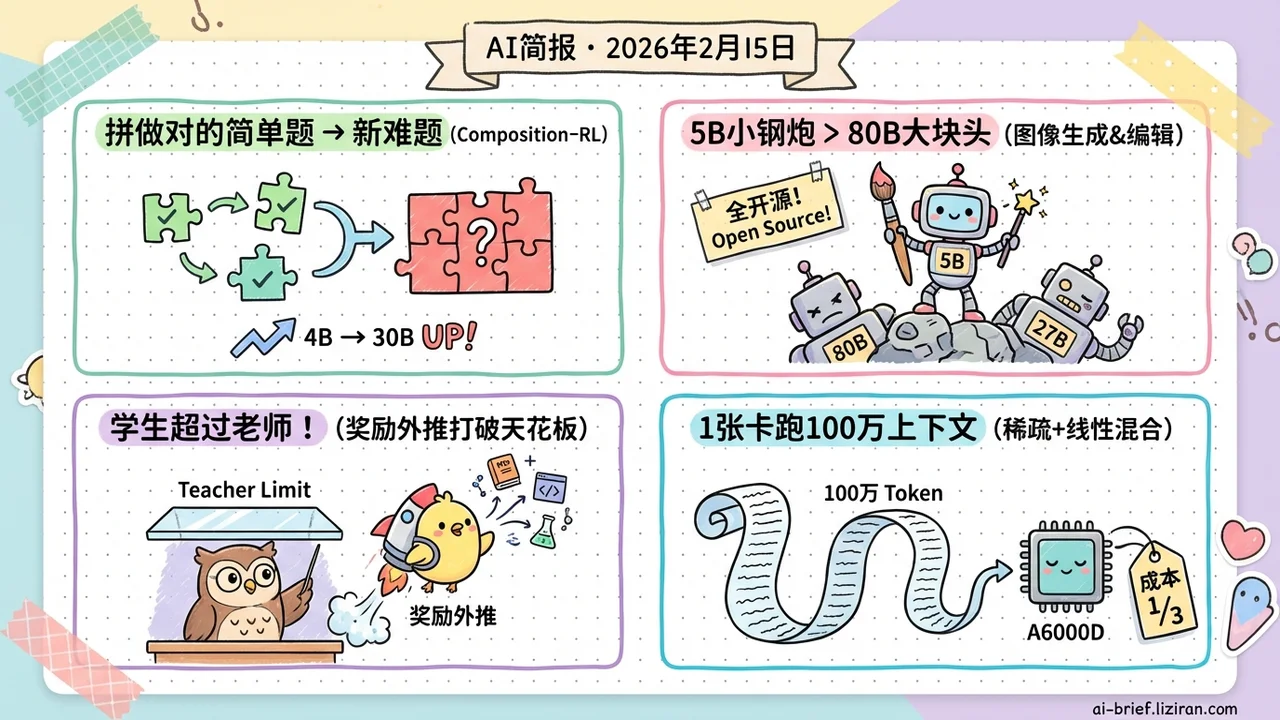

今日概览

- 把做对的简单题拼成新难题,Composition-RL让RLVR训练数据的有效利用率大幅提升,4B到30B模型一致涨点

- 5B参数做到80B的活。DeepGen 1.0在图像生成和编辑上同时超越体量大十几倍的对手,代码权重全开源

- 学生不仅能学老师,还能超过老师。ExOPD通过「奖励外推」打破蒸馏的性能天花板,多领域专家知识可合并回小模型

- 1张A6000D跑100万token上下文,MiniCPM-SALA用稀疏+线性注意力混合架构把长上下文推理成本砍到原来的1/3

重点关注

01 训练优化 RL训练的数据用完了?把简单题拼起来就是新难题

RLVR(强化学习+可验证奖励)训练大模型推理能力效果很好,但有个现实问题:训练题目是有限的,越练通过率越高,大量「已经做对了」的题目对训练没有贡献,等于白白浪费算力。以前的做法是优先挑难题练,但反过来太简单的题越来越多也没人管。Composition-RL的思路很直接:把多道简单题自动组合成一道新的复合题,答案可验证(每道子题独立判对错),相当于把「废弃数据」变成有挑战性的新训练样本。从4B到30B的模型上都有稳定提升,带课程学习(逐步增加组合深度)的变体效果更好。更实用的一点是这个方法天然支持跨领域组合——把数学题和代码题拼在一起训练,模型的跨域推理能力也能受益。

原文:Composition-RL: Compose Your Verifiable Prompts for Reinforcement Learning of Large Language Models

02 图像生成 5B参数凭什么打赢80B?

统一的图像生成+编辑模型是趋势,但当前的方案动辄10B以上参数,训练和部署成本都很高。DeepGen 1.0只有5B参数,却在生成和编辑两个方向同时拿下强结果:WISE上超越80B的HunyuanImage达28%,UniREditBench上超越27B的Qwen-Image-Edit达37%。核心设计是Stacked Channel Bridging——从VLM的多层提取层级特征,用可学习的「think tokens」融合后传给生成骨干网络,让小模型也能获得结构化的推理引导。训练流程分三阶段:对齐预训练、联合微调、再用混合奖励的GRPO做强化学习。整个训练只用了约5000万样本。代码、权重、数据集全部开源,对想做统一生成模型但苦于算力的团队来说是直接可用的起点。

原文:DeepGen 1.0: A Lightweight Unified Multimodal Model for Advancing Image Generation and Editing

03 训练优化 蒸馏的学生能超过老师吗?可以,只要你敢「外推」

模型蒸馏的天花板通常就是老师模型的性能——学生再怎么学也只是逼近老师。G-OPD(广义在策略蒸馏)把蒸馏重新理解为一种密集KL约束的RL问题,然后发现了一个关键杠杆:奖励缩放因子。标准蒸馏相当于把奖励信号和KL约束等权对待(缩放因子=1),而把缩放因子调到大于1——作者称之为ExOPD(奖励外推)——就能让学生突破老师的性能上限。在一个特别有实用价值的场景中,把不同领域专家模型的知识合并回原始学生模型时,ExOPD使学生同时超过了每个领域的专家老师。对做模型压缩和知识融合的团队来说,这个「缩放因子>1」的trick非常值得一试。

原文:Learning beyond Teacher: Generalized On-Policy Distillation with Reward Extrapolation

04 模型架构 1张消费级GPU跑100万token,长上下文不一定要大集群

8B级别的全注意力模型在256K token时已经吃不消内存,100万token更是不可能。MiniCPM-SALA(清华)的方案是混合注意力:1/4的层用稀疏注意力(InfLLM-V2)保留精确的长程建模能力,3/4的层用线性注意力(Lightning Attention)降低全局计算开销,再配合混合位置编码处理不同注意力机制的位置信号。更实用的是它不需要从头训——提供了一个持续训练框架,把已有的Transformer模型转换成混合架构,训练成本只要从头训的25%。在单张NVIDIA A6000D上,256K token推理速度是全注意力的3.5倍,支持最长100万token上下文。

原文:MiniCPM-SALA: Hybridizing Sparse and Linear Attention for Efficient Long-Context Modeling

也值得关注

今日观察

今天的highlight里有三篇都在解决同一类问题:RL训练中如何从有限数据里挤出更多信号。Composition-RL把简单题组合成复合题,ExOPD通过奖励外推让蒸馏突破教师上限,Length-Incentivized Exploration用长度奖励鼓励模型多探索——三条路径,共同指向「提高每条训练数据的边际收益」。做RL post-training的团队值得把这三个方法放在一起对比实验,特别是Composition-RL的跨域组合和ExOPD的多专家合并,组合起来可能有更大空间。