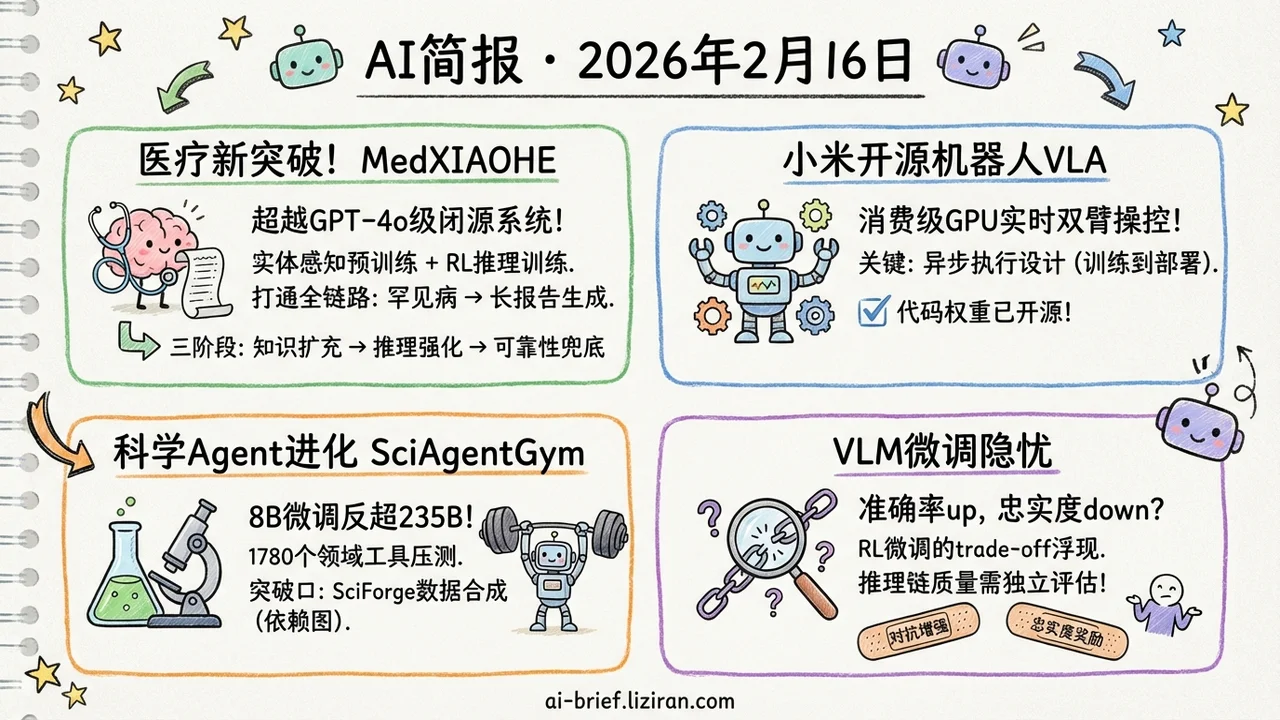

今日概览

- 医疗多模态模型开始超越GPT-4o级闭源系统,MedXIAOHE用实体感知预训练+RL推理训练打通了从罕见病到长报告生成的全链路

- 小米开源机器人VLA模型,消费级GPU上实现实时双臂操控,从训练到部署的异步执行设计是关键

- 科学工具调用是Agent的硬伤。SciAgentGym造了1780个领域工具做压测,8B模型微调后反超235B

- RL微调让VLM的benchmark分数上去了,但推理链的「忠实度」却在下降——准确率和可靠性的trade-off浮出水面

重点关注

01 多模态 医疗AI的「全能选手」长什么样?

医疗多模态模型面临一个独特困境:知识覆盖面要广(几千种罕见病都不能漏),推理深度要够(复杂诊断需要多步推理),输出还得可靠(长报告不能编造)。以前的模型通常只擅长其中一两项。MedXIAOHE的做法是分阶段解决:先用实体感知的持续预训练扩充知识面,把异质医学语料按实体组织起来填补长尾缺口;然后通过RL和工具增强训练让模型学会多步诊断推理,每步决策都有可验证的痕迹;最后加入用户偏好对齐和证据锚定来控制幻觉。在多个医学benchmark上超过了领先的闭源多模态系统。这套「知识扩充→推理强化→可靠性兜底」的三阶段路线,对其他垂直领域的多模态模型开发也有参考价值。

原文:MedXIAOHE: A Comprehensive Recipe for Building Medical MLLMs

02 机器人 消费级GPU跑实时机器人控制,小米怎么做到的?

VLA模型(视觉-语言-动作模型)的实际部署有一个绕不开的问题:推理延迟。模型生成下一步动作的时间如果超过控制周期,机器人就会卡顿甚至失控。Xiaomi-Robotics-0的核心设计是异步执行——训练阶段就让模型习惯「在执行上一步动作的同时预测下一步」,部署时再精心对齐相邻动作块的时间戳,确保动作连贯不断裂。模型先在大规模跨形态数据上预训练获得通用动作生成能力,再针对目标任务做后训练。实测在消费级GPU上就能流畅跑双臂精细操控任务,代码和权重已开源。对想在真实硬件上落地VLA的团队来说,这套异步训练+部署对齐的方案比单纯追求更大模型更务实。

原文:Xiaomi-Robotics-0: An Open-Sourced Vision-Language-Action Model with Real-Time Execution

03 Agent 科学工具链这么长,Agent走几步就迷路了

让AI Agent帮科学家做实验、跑分析听起来很美,但现实是:科学工作流涉及大量领域特定的工具和多步串联操作,现有Agent在这上面表现很差。SciAgentGym做了一次系统性压测——4个自然科学学科、1780个领域工具、从单步操作到长链工作流的分级评估。结果显示GPT-5在简单任务上有60.6%的成功率,但多步工作流一拉长就跌到30.9%。有意思的是作者提出的SciForge数据合成方法,把工具的调用关系建模为依赖图来生成训练轨迹,微调出的SciAgent-8B竟然超过了体量大30倍的Qwen3-VL-235B,而且还展现出跨学科的正迁移。这说明科学Agent的瓶颈不在模型大小,而在训练数据能不能教会模型理解工具间的逻辑依赖。

原文:SciAgentGym: Benchmarking Multi-Step Scientific Tool-use in LLM Agents

04 训练优化 RL微调的隐藏代价:分数上去了,推理链却不可信了

RL微调让VLM在视觉推理benchmark上涨分了,但有人仔细检查了推理链本身的质量。结论不太乐观:简单的文本干扰——比如加一段误导性的caption或错误的CoT——就能让模型表现大幅下滑。更关键的发现是,RL微调制造了一个准确率-忠实度trade-off——benchmark分数在涨,但CoT推理链与实际视觉证据的对齐度在降。作者尝试了对抗增强和忠实度感知奖励两个修复方案,前者能提升鲁棒性但不能阻止忠实度漂移,后者能恢复对齐但跟对抗增强组合时反而学会了捷径策略。这给所有在做VLM RL微调的团队敲了个警钟:只看准确率不够,推理链的忠实度需要独立评估。

原文:On Robustness and Chain-of-Thought Consistency of RL-Finetuned VLMs

也值得关注

今日观察

今天有一个明显的信号:AI正在加速从通用能力竞赛转向垂直领域深耕。医疗诊断(MedXIAOHE)、科学实验(SciAgentGym)、机器人操控(Xiaomi-Robotics-0)、地理推理(GeoAgent)——四个截然不同的领域,但解题思路高度一致:用领域专家的知识结构重新组织训练数据和奖励信号。尤其是SciAgent-8B用依赖图合成数据就超过235B通用模型这个结果,说明垂直领域的数据工程可能比堆参数更有效。做行业应用的团队值得重新审视自己的数据资产——领域know-how如何转化为训练信号,可能比选哪个基座模型更重要。