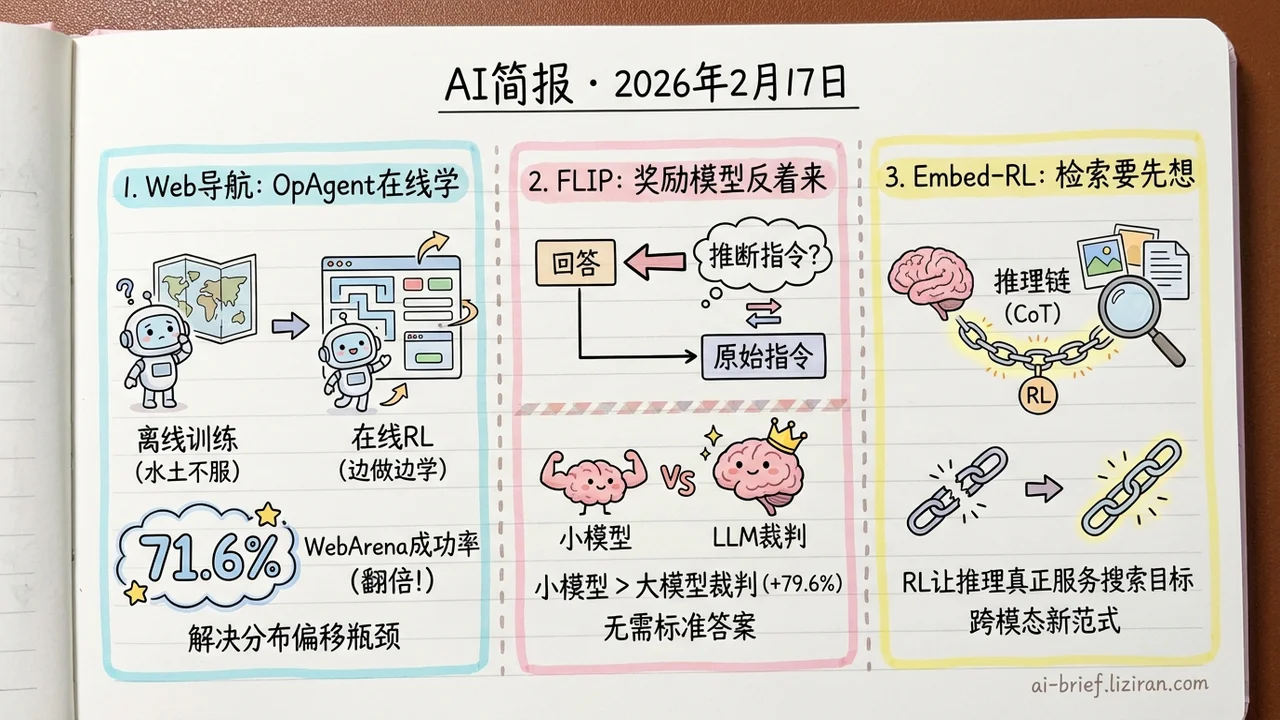

今日概览

- Web导航Agent在线学习终于跑通了,OpAgent在WebArena上达到71.6%成功率,比之前所有单体模型翻倍

- 奖励模型不一定要「正着判」。FLIP反过来推断指令,小模型比LLM-as-Judge强79.6%

- RL不止能训生成模型,也能训embedding模型的推理链,Embed-RL让跨模态检索学会了「先想再查」

重点关注

01 Agent 网页操作Agent终于学会在真实网站上「边做边学」了

让AI帮你操作网页——填表、下单、查信息——听起来简单,但现实中的网页千变万化,离线训练的Agent一上线就水土不服。核心问题是分布偏移:训练时用的静态数据集根本无法模拟真实网页的随机状态变化和即时反馈。OpAgent的做法是直接让Agent在真实网站上「边做边学」:先用分层多任务微调(规划、操作、定位分开练)打好基础,然后在真实网页环境中做在线RL。奖励设计很巧妙——一个「WebJudge」评估最终是否完成任务,一个规则决策树给中间步骤加进度奖励,解决长链任务的信用分配难题。单模型版本就做到38.1%成功率(pass@5),加上模块化的规划-定位-反思-总结框架后,直接刷到71.6%。之前同类最好的单体基线只有30%出头。做Web自动化产品的团队,在线RL这条路看起来比继续刷SFT数据集更有前途。

原文:OpAgent: Operator Agent for Web Navigation

02 训练优化 奖励模型不往前看,往回看

奖励模型(RM)是LLM训练和推理管线里的核心组件,但主流方案要么依赖大模型当裁判(LLM-as-Judge),要么需要参考答案或评分标准,灵活性和可及性都有限。FLIP换了个思路:拿到一个回答后,不是直接判断好不好,而是反过来推断「什么样的指令会生成这个回答」,然后比较推断出的指令和原始指令有多像——越像说明回答越切题。这个「反向推理」方法不需要参考答案、不需要评分规则,用7-9B的小模型就能跑。在13个小语言模型上测试,FLIP比LLM-as-Judge基线平均高出79.6%。更实用的是,在test-time scaling(并行采样选最优)和GRPO训练两个下游场景中,FLIP驱动的奖励信号都带来了显著提升,而且对长输出效果更好,对常见的reward hacking也更鲁棒。

原文:Small Reward Models via Backward Inference

03 多模态 跨模态检索也开始「先推理再匹配」了

多模态检索(图搜文、文搜图)以前的做法是直接把查询和目标编码成向量,然后比相似度。最近有人发现加一步CoT推理——让模型先分析查询意图再生成embedding——效果会好很多。但问题是,现有方法的推理链只在分析查询本身,跟实际要检索的目标毫无关系,等于推理和匹配是脱节的。Embed-RL用强化学习来修正这个脱节:Embedder(负责最终匹配的模型)直接给Reasoner(负责推理的模型)提供奖励信号,确保生成的推理链真正服务于检索任务。同时引入T-CoT(可追溯思维链),从多模态输入中提取关键视觉和文本线索作为检索证据。在有限算力下,这个框架在MMEB-V2和UVRB两个跨模态检索benchmark上超过了先前最好的embedding模型。

原文:Embed-RL: Reinforcement Learning for Reasoning-Driven Multimodal Embeddings

也值得关注

今日观察

今天有个有意思的交汇点:RL正在渗透到LLM管线中以前被认为「不需要RL」的环节。OpAgent把RL用在了Web Agent的在线策略学习,Embed-RL把RL用在了embedding模型的推理链优化,FLIP虽然本身不用RL但其输出直接服务于GRPO训练——RL不再只是对齐阶段的工具,而是成了改进几乎任何「有明确反馈信号的AI模块」的通用手段。做搜索、推荐、自动化等应用的团队,值得重新评估自己管线中哪些环节可以引入RL信号来优化。