今日概览

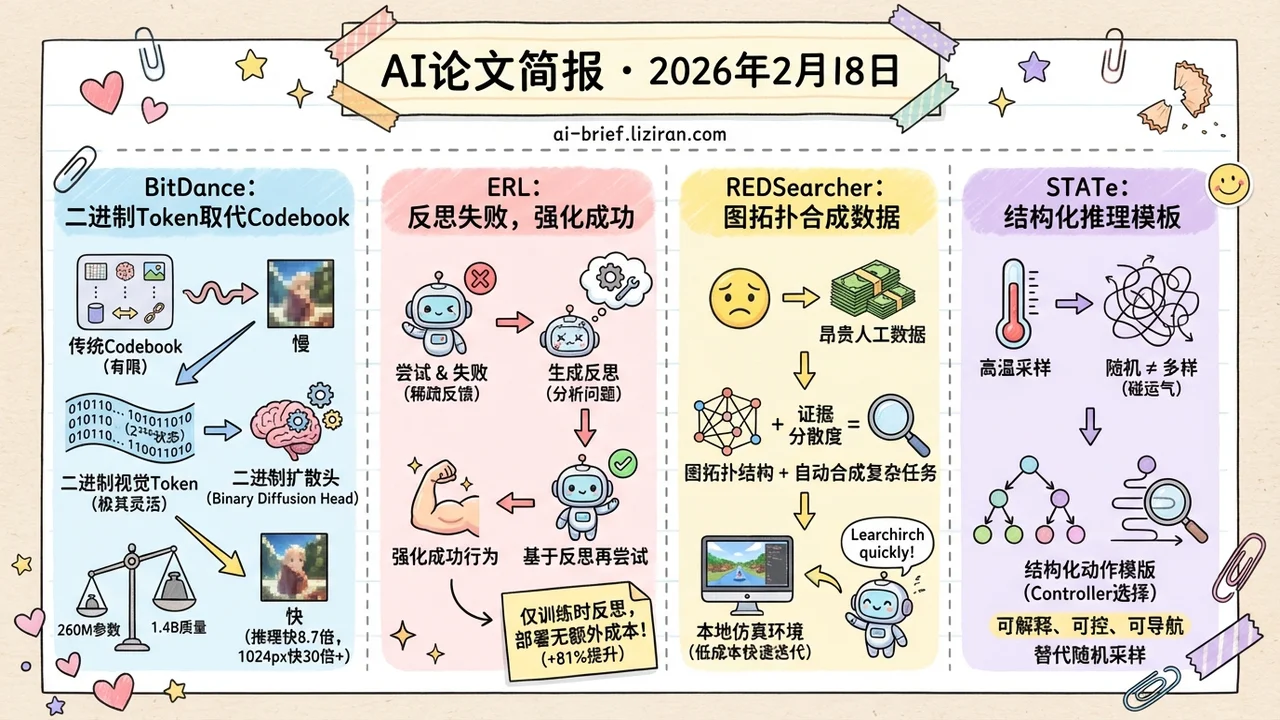

- 二进制token取代codebook索引,BitDance用260M参数打平1.4B模型的图像生成质量,推理快8.7倍,1024分辨率快30倍以上

- RL训练的反馈太稀疏模型学不动?ERL让模型先反思失败再强化成功,复杂环境提升最高达81%

- 搜索Agent的训练数据太贵太难造,REDSearcher用图拓扑合成高质量复杂任务,配合本地仿真环境大幅降低RL迭代成本

- 推理时计算还在靠高温采样碰运气?STATe用结构化推理模板替代随机采样,搜索空间更可控且可解释

重点关注

01 图像生成 一个token表示2^256种状态,图像生成靠二进制也能又快又好

自回归(AR)图像生成通常用codebook把图像编成离散token,但codebook大小有限,表达力受限。BitDance换了个思路:直接预测二进制视觉token——每个token可以表示$2^256$种状态,比传统codebook灵活几个量级。问题是这么大的token空间没法用softmax分类了,所以BitDance在AR框架里嵌了一个二进制扩散头(binary diffusion head),用连续空间扩散来生成二进制token。更实用的是,他们提出了next-patch diffusion——一次并行预测多个token,大幅加速推理。在ImageNet 256×256上FID达到1.24(AR模型最优),用260M参数打平了1.4B参数的并行AR模型,推理快8.7倍;生成1024×1024图像时更是比之前的AR模型快30倍以上。同一天发布的UniWeTok也走了类似路线——用$2^128$的二进制codebook做统一多模态tokenizer,在图像生成和理解上同时达到SOTA。二进制表示正在成为多模态tokenizer的新范式。

原文:BitDance: Scaling Autoregressive Generative Models with Binary Tokens

02 训练优化 让模型先反思为什么失败,再强化成功的行为

RL训练语言模型时有个老问题:环境反馈通常又稀疏又延迟。模型知道自己失败了,但不知道该往哪个方向改——只能靠隐式试错,效率很低。Experiential Reinforcement Learning(ERL)在RL循环里加了一个「体验-反思-固化」的显式环节:模型先做一次尝试,收到反馈后生成一段反思来分析哪里出了问题,然后基于反思做第二次尝试。如果第二次成功了,这个修正后的行为就被强化并内化到基础策略里。关键是,反思只在训练阶段使用——部署时不需要额外推理步骤,没有inference成本。在复杂多步控制环境中提升最高达81%,tool-use推理任务上也有11%的增益。

原文:Experiential Reinforcement Learning

03 Agent 搜索Agent训练最缺的不是模型,是高质量任务和便宜的试错环境

训练能做深度搜索的Agent面临两个成本瓶颈:一是构造复杂搜索任务极其费人工,二是每条训练轨迹都需要大量外部工具调用,rollout成本高得离谱。REDSearcher针对这两个瓶颈给出了系统方案。第一,它把任务合成建模为双约束优化——用知识图谱的拓扑结构控制任务难度,用证据分散度控制信息检索的复杂度,这样就能大规模自动生成难度可控的搜索任务。第二,在mid-training阶段先强化知识、规划、function calling三个原子能力,大幅减少下游收集高质量轨迹的成本。第三,搭建了一个本地仿真搜索环境,RL实验迭代速度大幅提升。在文本和多模态搜索Agent评测上都达到了SOTA,并且开源了10K文本+5K多模态搜索轨迹。

原文:REDSearcher: A Scalable and Cost-Efficient Framework for Long-Horizon Search Agents

04 推理 高温采样只能碰运气,结构化推理模板让搜索空间变得可控

Tree-of-Thoughts等推理时计算(ITC)方法需要生成多样化的候选方案,但实践中主要靠提高采样温度——温度高了确实更随机,但「随机」不等于「多样」,很多候选只是换了措辞而已。STATe-of-Thoughts用一种全新的方式实现多样性:把高层推理选择编码成离散的结构化动作模板,由一个controller选择推理策略,generator据此生成推理步骤,evaluator打分指导搜索。这比温度采样多样性更好,而且因为每个推理路径对应明确的动作序列,可以分析哪些推理策略倾向于产出高质量结果,甚至能发现尚未被探索但可能高效的推理区域并主动导航过去。这个方法最大的价值可能不在当下的性能数字,而在于它让ITC变得可解释、可分析、可引导。

原文:STATe-of-Thoughts: Structured Action Templates for Tree-of-Thoughts

也值得关注

今日观察

今天最显眼的信号是二进制token在视觉表示领域的同步爆发——BitDance和UniWeTok两个独立团队不约而同地选择了超大二进制codebook取代传统VQ,前者用于AR图像生成,后者用于统一多模态理解与生成。当两个互不知情的团队同时走到同一条路上,通常意味着这不是巧合,而是技术发展到了这个分岔口。做图像/多模态生成的团队值得关注二进制tokenizer这条路线,它可能会重新定义视觉token的设计范式。