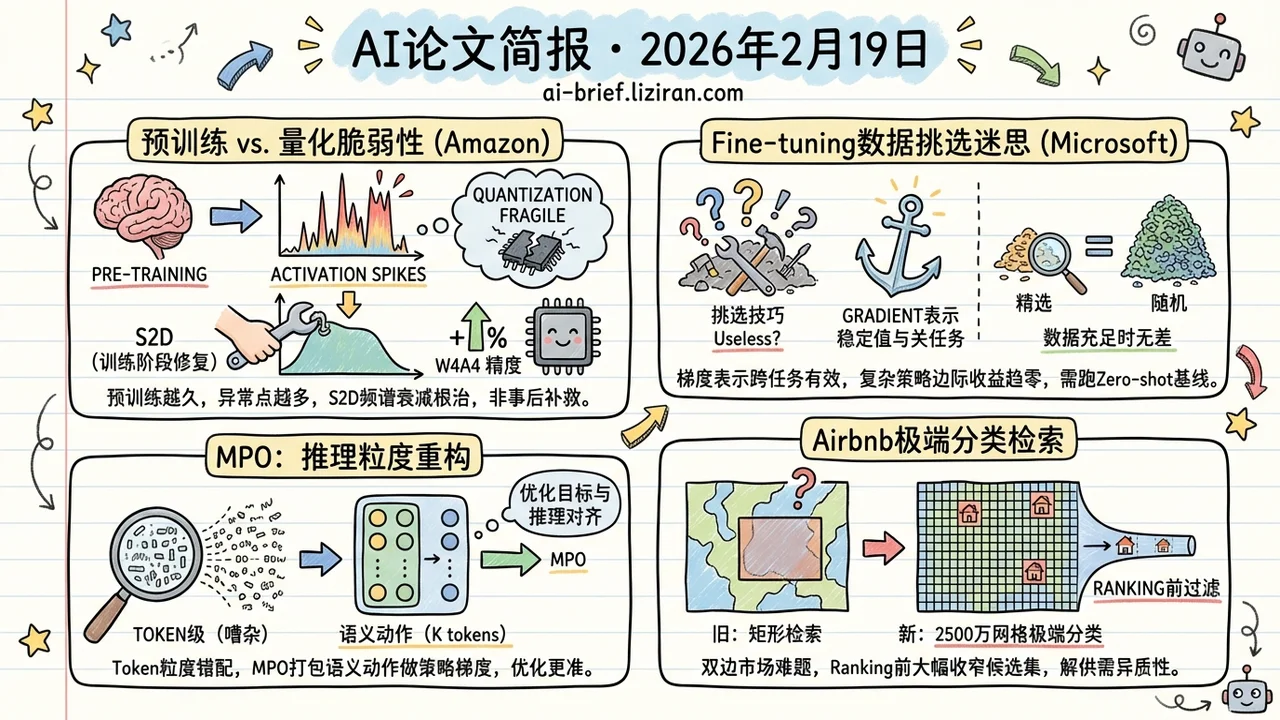

今日概览

- 预训练越充分,量化反而越脆弱:Amazon发现激活异常点严重程度与预训练规模正相关,S2D通过频谱衰减在训练阶段修复根因,W4A4精度最高回升7%

- 精心挑选fine-tuning数据的大部分技巧没用,Microsoft Research系统拆解后发现只有梯度表示跨任务稳定有效,数据量充足时精选与随机几乎无差

- token级策略梯度与推理的语义粒度根本错配。MPO把连续K个token打包为语义动作做策略梯度,让优化目标和推理结构对齐

- Airbnb把地理检索重构为2500万网格的极端分类问题,在ranking之前就大幅收窄候选集,解决双边市场供需异质性带来的检索难题

重点关注

01 推理加速 预训练越充分,量化反而越脆弱

Amazon的一组实验揭示了一个规律性现象:从CLIP到SigLIP再到SigLIP2,预训练越充分,模型激活值中的异常点越严重,量化后精度掉得越狠。进一步分析表明,这些异常点和权重矩阵中少数主导奇异值直接相关——预训练越久,这些奇异值越突出,激活值分布范围越大,量化时的精度损失就越不可控。S2D(选择性频谱衰减)的思路是在fine-tuning阶段对这些主导奇异值做针对性正则化,从根源上压缩激活值范围,而不是在量化阶段事后打补丁。实验结果扎实:W4A4量化下ImageNet精度最高提升7%,结合QAT(量化感知训练)还能再提4%,且改善在下游任务和视觉-语言模型上同样成立。这项工作的实际含义是,量化策略不应该是模型训好之后才考虑的事——训练阶段的正则化选择直接决定了量化的天花板,对计划做量化部署的团队来说,这两件事需要一起设计。

原文:S2D: Selective Spectral Decay for Quantization-Friendly Conditioning of Neural Activations

02 训练优化 Fine-tuning数据选择的花活,大多是浪费精力

针对目标任务精挑细选fine-tuning数据——这条赛道近两年涌现了大量方法,每篇论文都在选择策略上做文章。Microsoft Research系统性拆解了「数据表示」和「选择算法」两个核心组件,结论相当清醒:只有基于梯度的数据表示能跨任务、跨模型稳定预测下游效果,其他表示方式的表现忽高忽低。即使是最优组合(梯度表示+贪心轮询算法),优势也只在低预算场景下明显——数据量一上去,精心挑选和随机选的差距迅速缩小。另一个被忽视的问题是,很多论文根本没对比zero-shot基线,导致方法的实际增益被系统性高估。

原文:A Critical Look at Targeted Instruction Selection: Disentangling What Matters (and What Doesn't)

03 推理 一个token一个token地优化推理能力,方向就错了?

RL训练LLM的推理能力时,主流做法把每个token当成一个独立的「动作」来优化。但仔细想想——写一个等式、定义一个变量,本质上是一次语义决策,却被切成十几个token分别打分,梯度信号自然嘈杂。MPO(Multi-token Policy Gradient Optimization)换了个粒度:把连续K个token打包成一个语义动作来做策略梯度,让优化目标和推理的实际结构对齐。在数学推理和代码生成benchmark上,MPO优于标准的token级策略梯度基线。这个思路比调超参数根本得多——它质疑的是RL用于推理时的动作空间定义本身。

原文:Beyond Token-Level Policy Gradients for Complex Reasoning with Large Language Models

04 检索 把全球房源检索变成2500万类的分类问题

Airbnb的搜索系统面对一个经典的双边市场检索难题:全球房源差异极大,旅客偏好也千差万别,ranking模型再好,候选集不对也白搭。他们之前用深度贝叶斯bandit预测一个矩形检索区域来过滤房源,现在换了个思路:把全球地图切成2500万个均匀网格,用极端分类(extreme classification)直接预测哪些网格中的房源最可能被预订。本质上是把推荐问题转化成了超大规模分类问题,在ranking之前就大幅收窄候选集。这类真实双边市场检索系统的实战论文不多见,对做搜索和推荐架构的团队有参考价值。

原文:High Precision Audience Expansion via Extreme Classification in a Two-Sided Marketplace

也值得关注

今日观察

三篇论文各自在ML pipeline的不同环节撞上了同一面墙。S2D发现量化掉点的根因不在量化阶段——预训练时权重频谱中少数主导奇异值已经埋下了隐患。指令选择的系统拆解发现,数据表示方式、选择算法这些被反复研究的设计选择大多不影响最终效果,真正拉开差距的只有梯度表示这一个维度。MPO则指出token级动作空间和推理任务的语义粒度天然不匹配,换成语义级动作就能让策略梯度信号更清晰。

共同的教训很直白:在错误的抽象层次上做精细优化,效果有天花板。遇到量化掉点时,先检查训练阶段的频谱特性再调量化方案;微调数据选了很多花样但效果平台期,跑个随机基线看看差距是否真的显著;RL训练推理能力不收敛,重新审视动作空间的粒度定义。不急着调超参数,先确认自己在正确的层面上优化。