今日概览

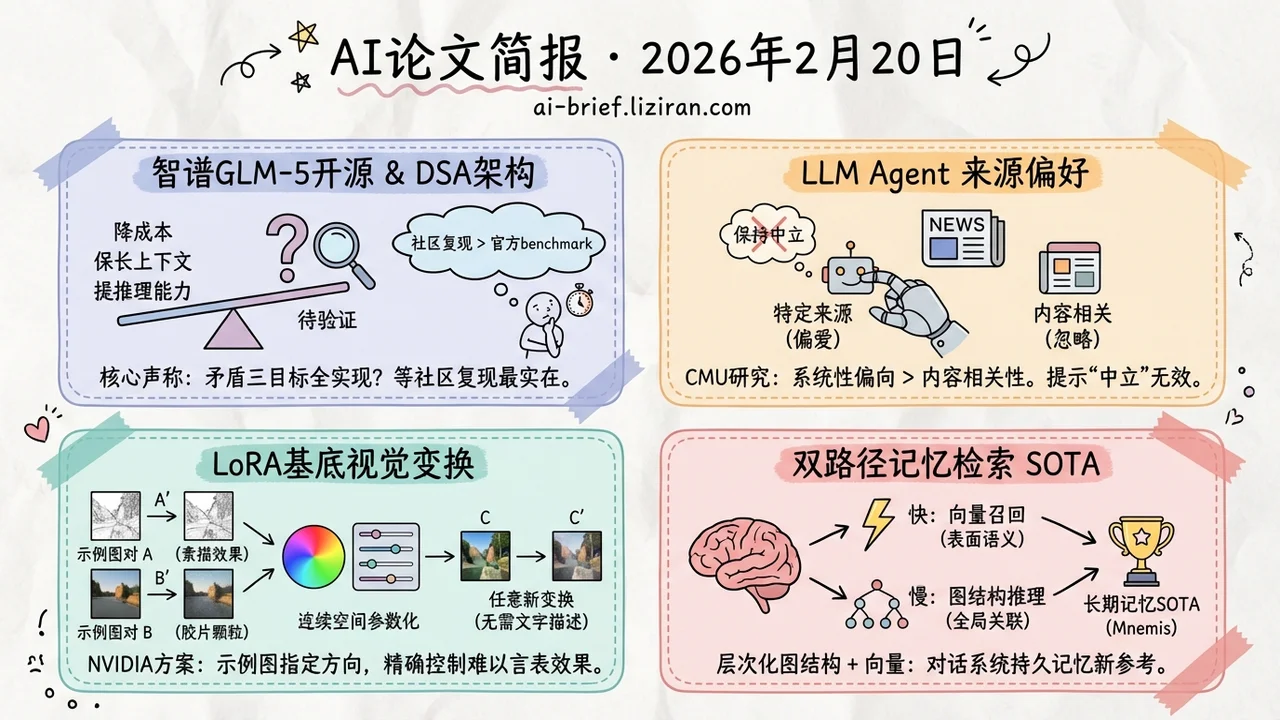

- 智谱GLM-5开源,核心架构声称尚待验证,DSA同时宣称降成本、保长上下文、提推理能力——三个通常互相矛盾的目标,等社区复现比看官方benchmark更实在。

- LLM Agent筛选信息时系统性偏向特定来源:CMU对12个模型的控制实验发现,来源偏好有时压过内容相关性,显式提示「保持中立」也无法消除。

- LoRA基底分解把视觉变换参数化为连续空间,NVIDIA的方案让一对示例图即可指定任意变换方向,不再需要文字描述难以言表的视觉效果。

- 双路径记忆检索在长期记忆benchmark取得当前最优。Mnemis在向量召回之上叠加层次化图结构的推理路径,对构建有持久记忆的对话系统有直接参考价值。

重点关注

01 模型架构 「Vibe Coding到Agentic Engineering」——智谱GLM-5的口号比技术走得更远?

智谱给GLM-5起了个抢眼的副标题,但「从vibe coding到agentic engineering」更像是营销定位而非技术突破的描述。抛开口号,值得拆解的是两个架构选择:一是DSA(论文未详细展开的新架构),声称同时降低训练和推理成本并保持长上下文能力——这三个目标通常互相矛盾,摘要中没有给出具体的成本对比数字,需要看全文确认实际trade-off。二是异步RL后训练基础设施,把数据生成和训练解耦,让模型能从更长horizon的agent交互中学习。这个方向本身合理——RL训练的瓶颈确实常在数据生成端,但「效率大幅提升」的幅度同样缺乏独立验证。摘要中提到「在主要开放benchmark上达到SOTA」,但智谱作为模型发布方自报的benchmark成绩,在没有第三方复现前只能作为参考。对从业者来说,更值得关注的信号是代码和模型已经开源——这意味着社区很快就能给出独立评估,到时候架构选择的实际价值自然会浮出水面。

原文:GLM-5: from Vibe Coding to Agentic Engineering

02 安全对齐 LLM Agent筛选信息时存在隐性来源偏好,用户毫不知情

LLM Agent越来越多地充当信息中间层——检索、筛选、综合,最终决定用户看到什么。CMU对6家厂商的12个模型做了控制实验,发现多数模型面对带来源标注的信息时,会系统性地偏向某些出版商或平台,即便明确提示「保持中立」也无法消除。更关键的是,这种来源偏好有时会压过内容本身的相关性——模型选择呈现哪条信息,部分取决于信息挂了谁的名字。对于用LLM做信息检索、推荐或决策辅助的产品,这意味着需要主动审计模型的来源偏好,而不是默认它是中立的。

原文:In Agents We Trust, but Who Do Agents Trust? Latent Source Preferences Steer LLM Generations

03 图像生成 不用文字描述,一对图片就能指定任意视觉变换?

「把图片变成铅笔素描」容易说,但「那种有点褪色、带胶片颗粒感、高光偏青的效果」呢——文字描述的表达力很快就会触顶。NVIDIA的LoRWeB做了一件很漂亮的事:学出一组LoRA基底模块,每个代表一种基础视觉变换,通过线性组合来表示任意新变换,相当于给图像编辑建了一个连续的坐标系。使用时只需给一对示例图(「从A到A'」),一个轻量编码器就能在这个坐标系中定位变换方向,然后把同样的效果施加到任何新图片上。以往单个固定LoRA很难覆盖多样的变换类型,而基底分解让模型在推理时动态组合出训练中没见过的变换,泛化能力明显优于现有方案。对做图像编辑产品的团队来说,「用示例图对指挥编辑」比文字prompt精确得多,这个交互范式值得关注。

原文:Spanning the Visual Analogy Space with a Weight Basis of LoRAs

04 检索 向量搜索快而不聪明,双路径架构补上推理检索

RAG的向量相似度检索本质上是System 1式操作——快速匹配表面语义,但碰到需要多步关联的查询就力不从心。Mnemis在此基础上叠加了一条「慢思考」路径:将记忆组织为层次化图结构,通过自顶向下的遍历做全局筛选,覆盖那些语义相似度搜不到但逻辑上相关的信息。两条路径互补,一条负责快速召回,一条负责结构化推理。在长期记忆benchmark上表现扎实,LoCoMo得分93.9,LongMemEval-S得分91.6,均为当前最优(基于GPT-4.1-mini)。对构建有长期记忆能力的对话系统或个人助理,这个双路径架构有直接参考价值。

原文:Mnemis: Dual-Route Retrieval on Hierarchical Graphs for Long-Term LLM Memory

也值得关注

今日观察

今天有两篇论文从不同方向指向了同一个容易被忽略的问题。Agent来源偏好研究发现LLM Agent在检索和综合信息时会偏向特定出版商和平台;Visual Persuasion研究发现VLM在视觉决策中会被特定构图和色调系统性影响。两个发现的共同点在于:模型并没有给出「错误」的答案,而是在筛选信息的过程中施加了自己的隐性偏好——用户拿到的是经过模型品味过滤后的结果,却以为自己看到的是客观中立的信息。

这跟传统的AI bias问题不同。传统bias是模型对某些群体的输出有偏差,可以用公平性指标来检测。而这里的问题是模型在充当信息过滤器时,对信息来源和视觉特征本身有偏差——它不是歧视谁,而是在帮你挑东西时悄悄加入了自己的品味。

对正在部署Agent做信息检索、推荐或采购决策的团队,建议在上线前做一轮筛选偏好审计:用相同内容挂不同来源标签测试文本输出是否一致,用控制变量的产品图测试视觉决策是否稳定。审计的不是回答准不准,而是筛选过程本身有没有系统性倾向。