今日概览

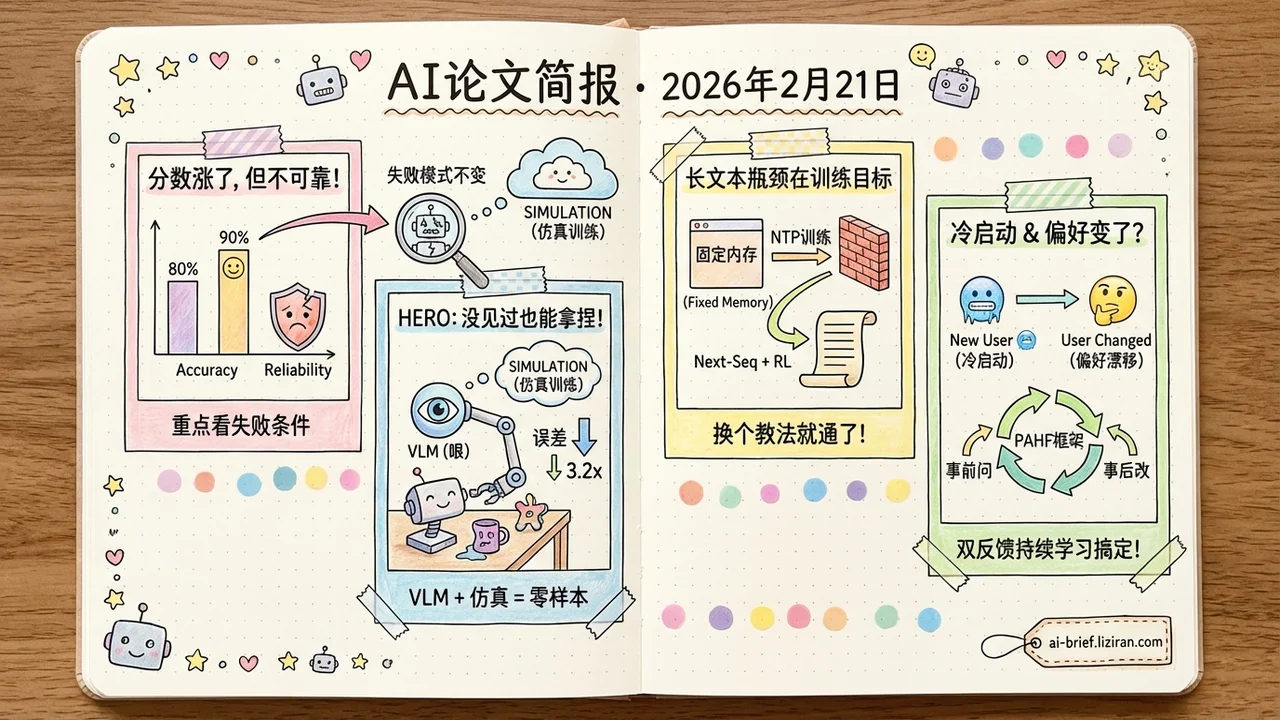

- Agent准确率从80涨到90,失败模式几乎没变。 14个模型实测显示,能力提升并未带来可靠性同步改善,从demo到production的决策应看失败条件而非平均分

- VLM+仿真RL绕过示教数据瓶颈: HERO让人形机器人零样本操控从未见过的物体,末端跟踪误差降低3.2倍

- Fast weight长文本瓶颈不在架构,在训练目标 — 换成next-sequence prediction配合RL,固定内存模型在长文本任务上首次具备实用竞争力

- 冷启动和偏好漂移被一个框架同时解决, Princeton的PAHF用持续学习加双反馈通道让Agent跟上用户不断变化的偏好

重点关注

01 Agent Benchmark分数年年涨,可靠性原地踏步

Agent benchmark分数年年涨,但把Agent真正部署到生产环境的团队都知道,准确率85%并不意味着可靠。这篇论文指出了评估体系的根本缺陷:单一成功率指标把一致性(多次运行结果是否稳定)、鲁棒性(输入稍有变化还能不能正常工作)、可预测性(失败是否有规律可循)、错误严重度(失败时造成多大损失)全部压缩成了一个数字。作者从安全关键工程领域引入思路,提出12个具体指标,沿四个维度拆解Agent的真实可靠性。在14个模型、两个benchmark上的测试结果不太乐观:近期模型能力的提升只带来了微小的可靠性改善。换句话说,一个Agent在benchmark上从80%涨到90%,它的失败模式和错误后果可能几乎没变。对于正在把Agent从demo推向production的团队来说,这个框架提供了一个更实用的评估视角——重点不是「平均能做对多少」,而是「在什么条件下会失败、失败时后果多严重」。

原文:Towards a Science of AI Agent Reliability

02 机器人 没见过的物体也能稳稳操作,靠的不是更多示教数据

训练机器人操控物体最大的瓶颈不是控制算法,而是数据——真实世界的示教数据极难规模化收集。HERO换了个思路:用大视觉模型(VLM)来「认识」物体,用仿真训练的RL策略来「动手」,两者模块化组合。核心创新在末端执行器跟踪——结合逆运动学和学习的神经前向模型,加上目标调整和重规划机制,跟踪误差降低了3.2倍。效果很直观:机器人走进办公室、咖啡店,面对从没见过的马克杯、苹果、玩具,在43cm到92cm不等的桌面上都能稳定操作。这跟前几天小米Robotics-0解决推理延迟是不同方向——HERO解决的是「见都没见过怎么操作」的泛化问题。

原文:Learning Humanoid End-Effector Control for Open-Vocabulary Visual Loco-Manipulation

03 模型架构 训练目标换一下,固定内存架构的长文本能力就追上来了?

Fast weight架构用固定大小的内存动态存储上下文,理论上很适合长文本:内存开销不随上下文长度增长。但实际表现一直差强人意,问题不在架构本身,而在训练方式——逐token预测(NTP)只优化下一个token的准确率,导致fast weight存储的上下文信息碎片化,跨token的语义关联丢失。REFINE把训练目标换成next-sequence prediction:基于预测熵选择关键位置,生成多token序列,再用GRPO强化学习做序列级优化。在LaCT-760M和DeltaNet-1.3B上,这套方法在needle-in-a-haystack检索和LongBench等长文本任务上一致超过NTP微调基线。方法可以用在预训练中期、后训练和测试时训练三个阶段,通用性不错,但目前只在两个模型上验证过,规模化效果还需要更多数据支撑。

原文:Reinforced Fast Weights with Next-Sequence Prediction

04 Agent 用户偏好会变,你的Agent记忆跟得上吗?

做过Agent产品的都知道两个老难题:新用户来了没有历史数据可用(冷启动),老用户偏好变了但模型还在用旧画像(偏好漂移)。现有方案要么靠交互历史训练隐式偏好模型,要么把用户画像编码进外部记忆,两条路各解决一半问题。Princeton的PAHF提出一个持续学习框架,核心是三步循环:行动前主动询问消除歧义,行动时基于记忆中的偏好做决策,行动后根据反馈更新记忆。关键设计是「双反馈通道」——事前澄清和事后纠正同时存在,实验显示这比只用单通道的基线学得更快,且能跟上偏好变化。思路扎实,但目前只在具身操控和在线购物两个benchmark上验证,离真实消费场景还有距离。

也值得关注

今日观察

今天三篇不相关的论文从不同维度拆解了同一个问题:Agent的「可靠性」不是一个数字能概括的。

Agent Reliability那篇把operational reliability分成四个轴——一致性、鲁棒性、可预测性、错误严重度。PAHF解决的是temporal reliability:用户偏好在变,Agent必须跟上。也值得关注中的MMA解决的是evidential reliability:记忆条目可能过时或矛盾,需要动态置信度评估。

这跟软件工程的演化路径很像。SLA不是一个数字,而是可用性、延迟、吞吐、一致性的组合。Agent的「质量」正在经历同样的分解——从「能不能完成任务」进入「以什么质量完成任务」的工程化阶段,而「质量」本身被拆成了可独立衡量、可独立优化的子问题。

如果你在做Agent产品,现在可以做一件事:别只盯端到端成功率,把可靠性拆成至少三个独立维度来监控——操作一致性(同样输入跑十次结果是否稳定)、偏好追踪准确度(用户纠正频率是否在下降)、记忆可信度(检索到的上下文有多少是过时的)。哪个维度拖后腿,对应的优化策略完全不同。