今日概览

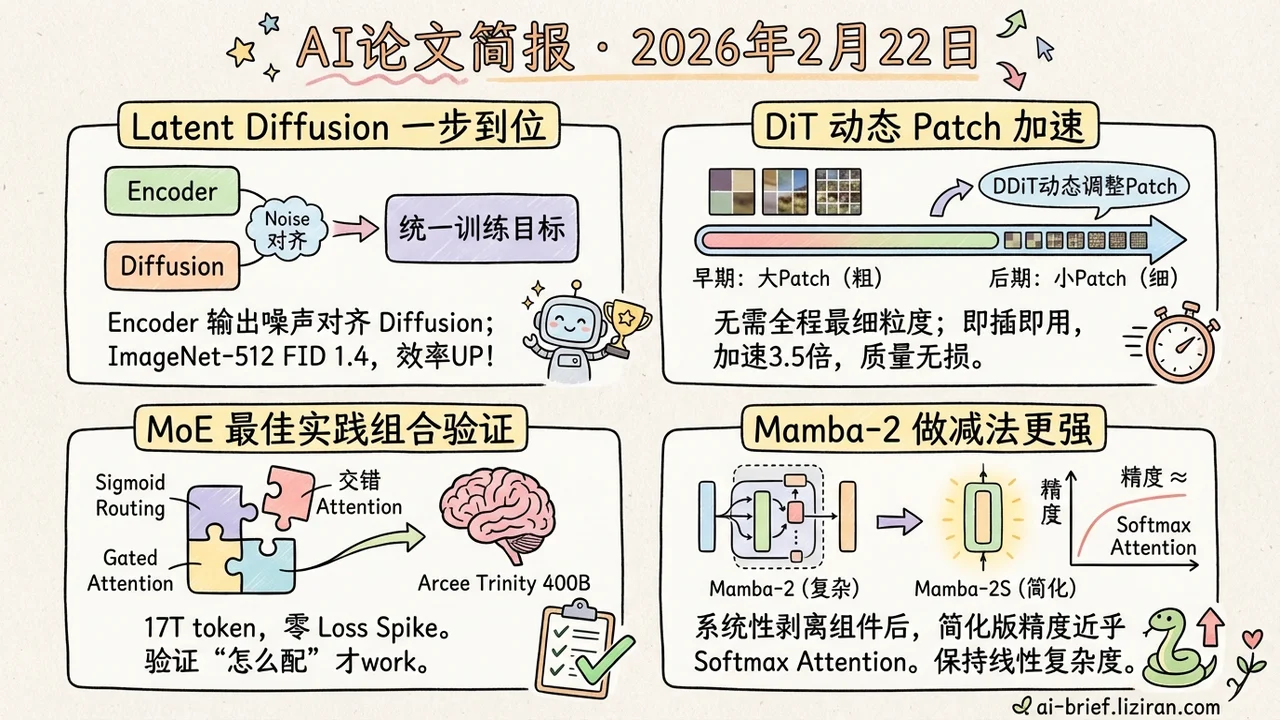

- Latent diffusion的两步训练可以统一为一步,encoder输出噪声与diffusion噪声level对齐后训练效率更高,ImageNet-512达到FID 1.4。

- DiT去噪不需要全程最细粒度:DDiT按内容复杂度动态调整patch大小,即插即用加速3.5倍且质量无损。

- MoE最佳实践的完整组合验证——Arcee Trinity用sigmoid routing等已验证技术训400B参数模型,17T token零loss spike。

- Mamba-2做减法反而精度更高。 系统性剥离组件后,简化版在保持线性复杂度的同时几乎追平softmax attention。

重点关注

01 图像生成 把encoder和diffusion的训练目标统一,能省多少?

Latent diffusion的标准流程是先训encoder/decoder,再训diffusion model,两步的优化目标互不相干。Unified Latents(UL)的核心洞察很直接:把encoder输出的噪声level和diffusion prior的最小噪声level对齐,这样就能推导出一个同时约束两者的训练目标——具体来说是latent bitrate(潜空间编码率)的紧上界。结果是ImageNet-512上FID 1.4,重建质量(PSNR)也保持在高位,同时训练FLOPs比在Stable Diffusion latents上训练的同级模型更低。视频方面,Kinetics-600上FVD 1.3刷新了此前最好记录。方法本身的价值不在于某个benchmark数字,而在于把latent space训练从「两步分离」简化为「一步统一」——如果这个范式能泛化到视频和3D生成,影响面会比单纯的图像指标大得多,但目前需要更多下游任务的验证。

原文:Unified Latents (UL): How to train your latents

02 推理加速 DiT去噪的每一步都用最细粒度处理,这本身就是浪费

扩散Transformer(DiT)在去噪的前几步处理的几乎是纯噪声——用最小的patch逐像素建模全局结构,就像用放大镜看一面白墙。DDiT的做法很直觉:早期用大patch快速勾勒结构,后期再换小patch打磨细节,根据内容复杂度和去噪阶段动态调整粒度。关键是这个策略完全在推理时生效,不需要重新训练模型,对现有DiT即插即用。在FLUX-1.Dev上加速3.52倍、在Wan 2.1上加速3.2倍,生成质量和prompt adherence基本无损。属于那种「为什么之前没人做」的优化——不改架构、不改权重,只改token化策略就能省掉大半计算。

原文:DDiT: Dynamic Patch Scheduling for Efficient Diffusion Transformers

03 模型架构 已知的MoE最佳实践组合验证,400B参数17T token零loss spike

训MoE模型,单个技术选择已经不稀缺——sigmoid routing、交错局部/全局注意力、gated attention、depth-scaled sandwich norm,每个都有论文支撑。Arcee Trinity的价值在于把这些选择组合到一起,从1B到13B激活参数跑了三个规模(6B/26B/400B总参数),17万亿token训完零loss spike。这不是某个单一突破,而是对当前MoE架构「怎么选、怎么配」的一次完整验证。其中新提出的负载均衡策略SMEBU(基于动量的专家偏置软钳位更新)和Muon优化器的选用,是两个值得单独关注的技术点。对正在做架构选型的团队来说,这份技术报告比单篇方法论文更实用——它回答的是「这些东西放在一起能不能work」。

原文:Arcee Trinity Large Technical Report

04 模型架构 做减法的Mamba,反而更接近Transformer的精度?

直觉上,linear attention精度不够,解决方案应该是往上加东西——更复杂的门控、更多的注意力头、混合架构。2Mamba2Furious反过来操作:对Mamba-2做系统性拆解,一层层剥离组件,看哪些真正影响精度。结果出人意料——简化后的Mamba-2S不仅没变差,改进A-mask和提升隐状态阶数(hidden state order)后,精度几乎追平softmax attention,长序列的显存效率还保持着线性复杂度的优势。更有趣的是,他们还找到了让Mamba超越softmax attention精度的配置要素。

原文:2Mamba2Furious: Linear in Complexity, Competitive in Accuracy

也值得关注

今日观察

今天排名最高的三篇论文在三个不同环节做了同一件事:找到pipeline中粒度一刀切的地方,换成自适应的。

UL发现encoder和diffusion各自定义latent space是多余的分裂——对齐噪声level后训练更高效。DDiT发现去噪每一步都用最小patch是多余的均匀性——按阶段和内容调粒度后省掉大半计算。2Mamba2Furious发现Mamba-2的很多组件是多余的复杂性——系统性简化后精度反而更高。

同一个模式:现有设计中存在大量「全程同规格处理」的默认选择,不是优化的结果,只是最初实现时图方便。把固定粒度换成自适应粒度时,往往发现大半计算本就多余。

审视你pipeline中的均匀处理环节——固定的token长度、不分阶段的统一推理步数、全batch同规格。问自己:这个处理粒度是验证过的最优值,还是只是默认值?后者就是效率改进的入口。