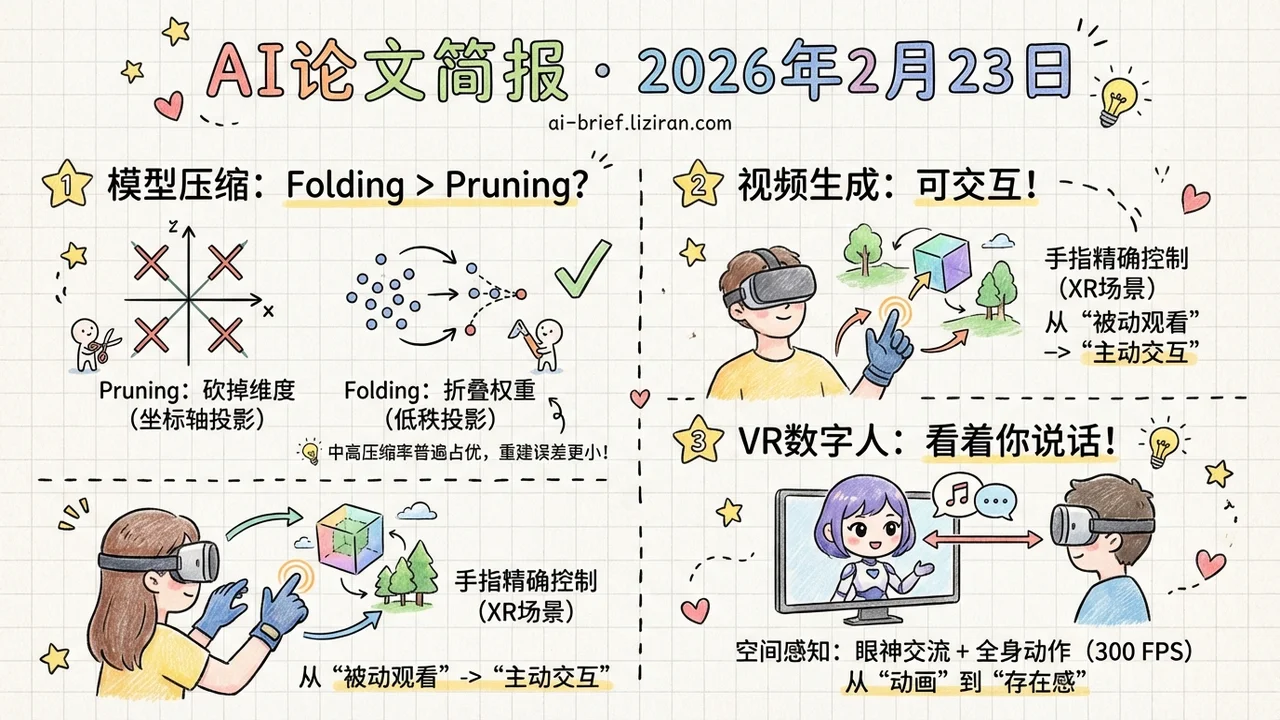

今日概览

- 模型压缩不一定要剪枝,ICLR 2026的理论和实验表明weight folding(低秩投影)在大多数压缩率下重建误差更小。

- 视频生成模型开始真正响应人的肢体动作。手指级别的控制精度让XR场景变得可交互,不再只是看。

- VR对话Agent终于能看着你说话了:SARAH实时生成空间感知的全身动作,300 FPS,支持流式VR部署。

重点关注

01 推理加速 压缩模型:折叠比剪枝好在哪?

结构化剪枝是部署大模型的标配操作——砍掉不重要的通道或层,模型变小,推理变快。但剪枝本质是沿坐标轴做投影,把某些维度直接归零。Folding换了个思路:通过weight clustering做低秩投影,不是砍掉维度,而是把相近的权重「折叠」到一起。作者从投影几何的角度证明了,在秩距离为1的条件下,folding的参数重建误差严格小于pruning。实验覆盖了1000+个checkpoint(ResNet、ViT、CLIP、LLaMA系列),在中高压缩率区间folding的压缩后精度普遍更高,只在某些特定训练配置下pruning才反超。对做部署优化的团队来说,这意味着「默认剪枝」的惯性可能需要重新审视——至少应该把folding加入对比基线。

原文:Cut Less, Fold More: Model Compression through the Lens of Projection Geometry

02 多模态 视频世界模型终于能跟踪你的手了

XR(扩展现实)对视频生成有个特殊需求:模型不只要生成好看的画面,还要实时响应用户的头部姿态和手部动作。目前的视频世界模型大多只接受文本或键盘这类粗粒度输入,离「用手去摸虚拟物体」还很远。Generated Reality做的事是在diffusion transformer上加入头部6DoF位姿和关节级手部姿态的条件控制,训练一个双向视频扩散模型作为teacher,再蒸馏成因果式的交互系统,能流式生成第一人称虚拟环境。用户实验显示,参与者感受到的操控感显著高于基线方法。这是视频生成从「被动观看」走向「主动交互」的一步,对做XR产品的团队是直接相关的技术信号。

03 多模态 VR数字人终于知道你站在哪了

做对话式数字人最常见的短板不是嘴型不对、不是手势不自然——是它不看你。你绕到它侧面,它还对着前方打手势。SARAH解决的就是这个空间感知问题:输入用户的位置和双人对话音频,输出包含朝向、眼神、手势的全身动作。架构用了因果transformer VAE加flow matching,音频和用户轨迹作为条件。一个有意思的设计是眼神接触的强度可以在推理时用classifier-free guidance调节,不需要重新训练。在Embody 3D数据集上达到SOTA,速度超过300 FPS,比非因果基线快3倍,已在实时VR系统上验证部署。对做数字人或远程协作产品的团队来说,空间感知是区分「工具」和「存在感」的关键。